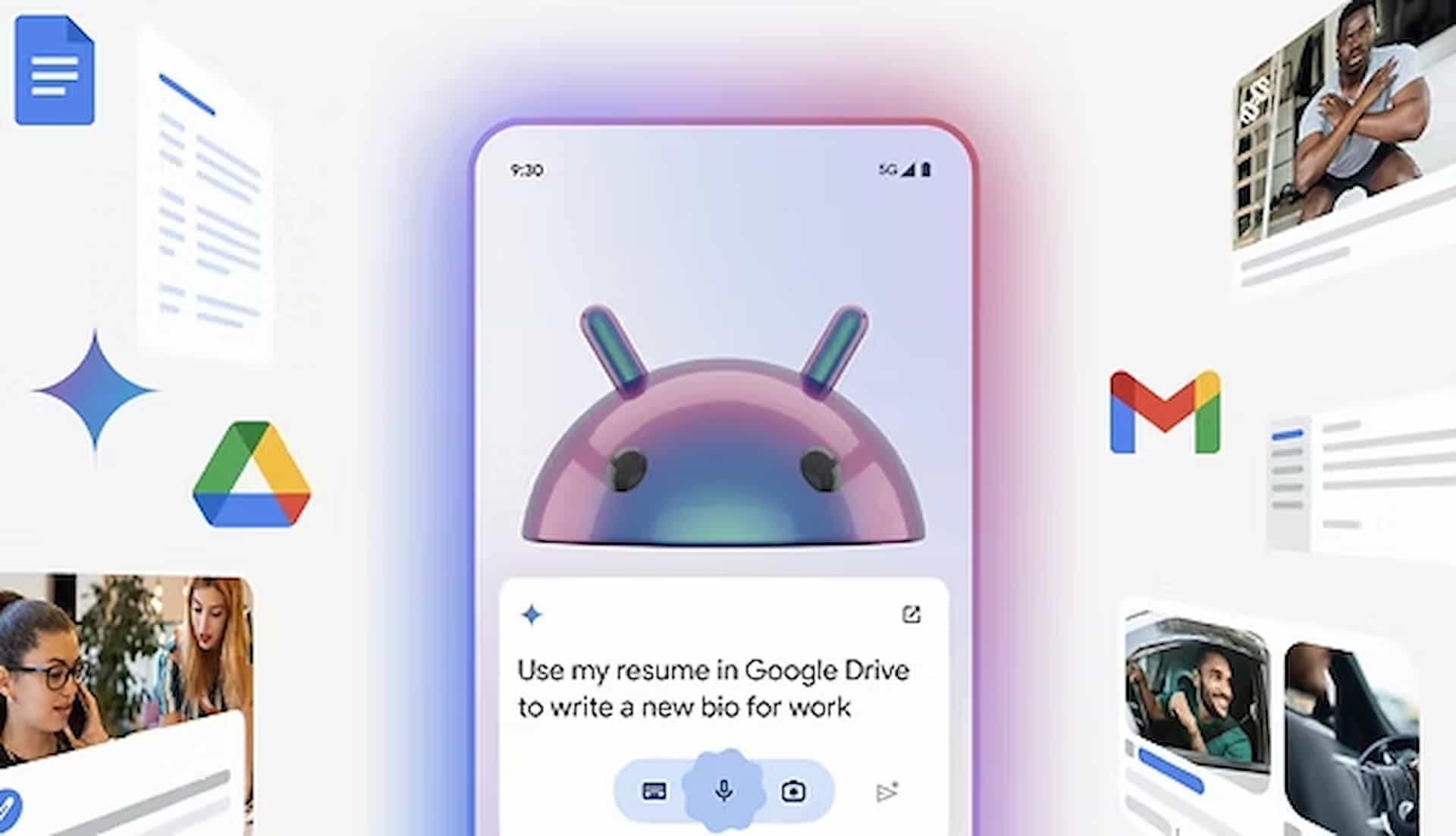

Google está desarrollando cambios que permitirán integrar agentes de IA en Android capaces de ejecutar tareas dentro de aplicaciones. La iniciativa busca modificar la forma en la que se utilizan los smartphones, permitiendo que asistentes inteligentes interpreten una solicitud y coordinen las funciones necesarias para completarla.

En este modelo, la inteligencia artificial actúa como una capa intermedia entre el usuario y las aplicaciones. En lugar de abrir una app y navegar por sus menús, bastaría con expresar una acción para que el sistema intente resolverla utilizando distintas funciones del teléfono.

Android con agentes de IA: cómo funcionará este modelo

El enfoque de Android con agentes de IA plantea que los asistentes pasen de responder consultas a ejecutar acciones dentro del sistema.

En el ámbito de la inteligencia artificial, un agente es un sistema diseñado para comprender una intención y planificar los pasos necesarios para cumplirla. Para ello combina varias capacidades:

- Comprensión del lenguaje natural

- Análisis del contexto

- Ejecución de acciones dentro de aplicaciones

Esto implica un cambio en la forma en la que se diseñan las aplicaciones. Durante años, el objetivo de las apps era que el usuario las abriera y realizara todas las acciones dentro de su interfaz. Con este nuevo enfoque, el sistema podría completar tareas sin que el usuario interactúe directamente con cada pantalla.

AppFunctions: la base para integrar IA en Android

Uno de los componentes que Google está introduciendo se denomina AppFunctions.

Se trata de un conjunto de herramientas destinadas a desarrolladores para que puedan exponer funciones de sus aplicaciones a asistentes inteligentes como Gemini.

Esto permitiría que el asistente acceda a determinadas funciones de una app para completar tareas. Un ejemplo mencionado por Google es la posibilidad de solicitar que el sistema muestre fotos específicas dentro de una galería.

En ese caso, el asistente interpreta la solicitud, activa la función correspondiente dentro de la aplicación y devuelve el resultado sin que el usuario tenga que navegar manualmente por la interfaz.

Automatización de interfaz con Gemini

Además de las integraciones directas entre aplicaciones y asistentes, Google está preparando un segundo enfoque basado en automatización de interfaz.

Este sistema permitiría que Gemini interactúe directamente con la interfaz de una aplicación para completar tareas de varios pasos, incluso cuando la app no tenga una integración específica con el asistente.

Según la compañía, el usuario podrá:

- Seguir el proceso mediante notificaciones o una vista en directo.

- Recuperar el control manual en cualquier momento.

- Recibir avisos antes de realizar acciones sensibles, como compras.

Las primeras pruebas de esta función se realizarán en la serie Galaxy S26 y en algunos Pixel 10, dentro de la aplicación de Gemini. Inicialmente se probará con un conjunto limitado de aplicaciones de reparto, supermercados y transporte en Estados Unidos y Corea.

El futuro de Android con inteligencia artificial

Las funciones presentadas por Google todavía se encuentran en desarrollo y su despliegue será gradual. Sin embargo, el anuncio muestra la dirección en la que podría evolucionar el sistema operativo.

El objetivo es avanzar hacia un Android en el que los agentes de IA participen activamente en la ejecución de tareas cotidianas, coordinando funciones del sistema y de distintas aplicaciones.

Google señala que estas capacidades podrían expandirse a más fabricantes a medida que evolucionen las herramientas y el ecosistema de aplicaciones.